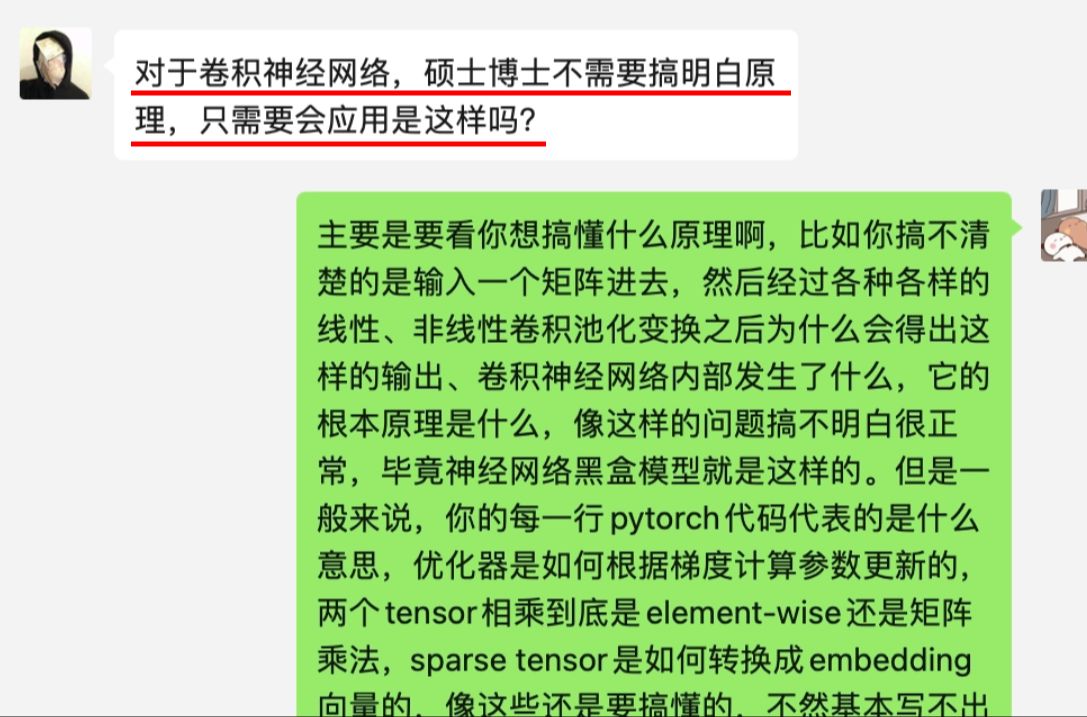

对于卷积神经网络,硕士博士不需要搞明白原理,只要会应用是这样吗?-pytorch/深度学习/神经网络

少万寻:

少万寻:

炼丹四阶段:

炼气期:能复现代码并且换成自己的数据集

筑基期:能理解模型架构和超参的思想,并能有效调参

结丹期:能够理解代码细节,添加模块,分析实验结果的... 多大药丸:

多大药丸:

统计和数学都好好学的话,cnn的知识点全都是本科的,一点朝纲的都没有[无语]

【回复】重点:《好好学》[吃瓜][吃瓜][吃瓜]

【回复】回复 @AI算法工程师Future :考研数学有个100分足够了

【回复】你以为学不会cnn是大伙笨吗?是本科没学好吗?[吃瓜]是信息差 泡泡茶壶的茶:

泡泡茶壶的茶:

你不看点原理,你能接受,你能说服自己,那还是要点本事。

【回复】回复 @Fang-WD :难倒不是很难,就是推公式是一个比较繁琐的过程,现在封装的太好了,基本上不用懂原理,也能用。但是想有点突破就得看看公式,推出来公式那种拨云见日感觉非常爽。有些原理,有些公式美的像一幅画一样。

【回复】卷积神经网络原理很难吗[笑哭]我24考研考的人工智能,我还是文跨理,本科学的金融,因为大二大三感兴趣就把机器学习深度学习强化学习都玩了一遍,不过当时只是会应用。现在在家自学深度学习理论,感觉理解上也没啥问题吧[笑哭]

【回复】回复 @战阵冲杀 :这句话充满了偏见和自大啊 Seventeen_W_:

Seventeen_W_:

对于本科生,我只要改一丝丝backbone,然后让他在我电脑上能跑起来就已经心满意足了[doge]

【回复】我也这么想,能跑能用就好, sh0ck1ng:

sh0ck1ng:

我知道神经网络基本是怎么公式算出来的,但是我就是不知道为什么这个参数好,那个参数差,这个说不准

【回复】不然为啥叫炼丹呢[吃瓜],是长期累积的经验[doge]

【回复】我看过弗朗克肖莱的书(keras的撰写者),他认为参数的调整只有一些基本的原则需要遵守,至于究竟什么参数好什么参数不好,他自己也解释不了,他认为这更像一门艺术而非科学。所以这种东西实践出真知,培养的是直觉,考验的是耐心[奶蓝梦境_喵]

【回复】回复 @爱吹口哨的发发同学 :大脑团队的调参指南[吃瓜] 谭雅__冯__提古雷查夫:

谭雅__冯__提古雷查夫:

[吃瓜]不是不需要弄明白原理,而是到现在为止还没发现原理是什么,就比如卷积核最重要的一个概念,局部特征,谁能告诉我局部特征的准确数学定义?[吃瓜]好像没有,有的话应该能够极大推进卷积的发展。

【回复】通信原理和信号系统中两个一维信号卷积时,需要把其中一个信号沿着纵轴转180度,也称为匹配滤波。但是两个二维信号卷积时,不需要如上的转180度的处理。

【回复】回复 @我是全A君 :[吃瓜]这么跟你说吧,就拿resnet来说,我记得最后一层应该是2048个3x3卷积核,每一个卷积核代表了一个局部特征,他们代表的局部特征大概率是不重复的,那么你应该用一个什么样的值?或者说一个具体标准,来描述这绝大多数不重合的卷积核,对于每个矩阵而言,它的秩是唯一的,那么对于每一个局部特征什么东西对于他来说才是唯一的?关键你要能给出一个具体的值,我觉得如果能给出来的话,那么简化网络结构就能够极大的被推进,或者说他们有理可依。

【回复】学一下图像处理,看看传统手工设计的各种算子 青思华发:

青思华发:

大部分人理解都是从抽象的层面,什么感受野啊,提取特征啊,这种讲故事的话术。为什么好,大家不知道,用过之后就是好,于是大家都用这个,尝试从各个角度开始解释,给你严格的数学证明,那是佬中佬了。

【回复】回复 @乌丸万岁 : 感受野是一个客观的可量化的指标,就是一个输出和几个输入有关

【回复】你觉得感受野这种名词是抽象概念的话那你也没理解,神经网络本质上是一个含参的泛函代表了一簇函数,我们做的一切操作都是为了两个目的①让函数集中与目标函数最佳逼近的函数,距离越小越好②让函数集合中的无用函数越少越好,对应了研究中的高精度和快收敛两个目标

而感受野是cv中最直观的评价函数集合大小的一个指标,因为理想条件下,输出应该与所有输入像素都有关,但CNN是不可能做到这一点的,因为运算中某一输出表达式不会包含所有输入 夜雨航船:

夜雨航船:

若非本硕985+有SCI论文,若非读博,立刻run出这个方向,至少就业不要指望,因为你根本找不到工作

【回复】回复 @Maggie豆dou :他说的是对的,深度学习只能发文章水论文,就业还是省省

【回复】本科生DRL做金融量化怎么说[呲牙] Tony-23:

Tony-23:

up主能不能推荐推荐最新的关于模型的书吗?或者评论文章也行,感恩了

【回复】麻省理工出版的理解深度学习,是英文书 lonely漠影:

lonely漠影:

主要看你拿它来干嘛,如果只是需要应用一下,远离不懂就不懂,只要它好使就行,如果是你的课题就是它本身。。原理不懂还研究个der 草心cx:

草心cx:

ai专业的理论学了不少,搞算法竞赛代码敲了不少,但是不会python搓不出模型,不会挂服务器调环境,我怕不是废了[笑哭] 大天才呀我:

大天才呀我:

卷积提取特征真的不好说清楚,和我们理解的特征有点区别,这个卷积后结果没必要搞清楚,当然你也可以去看看cnn explainer,上面有每一步卷积,池化等的结果图像

【回复】回复 @小谢爱爬山 :获取函数值与获取导数的卷积操作,反映在图像处理中就是平滑处理与边缘检测。这些是我们易于理解的“特征”。但是更多情况下,卷积操作提取的特征并不是这些我们易于理解的形式,“特征”就变成了一个抽象的概念。实际上,每种卷积操作就能对应一种特征的形式,完全可以千奇百怪。

【回复】回复 @小谢爱爬山 : 引用数字信号处理这门课的意义,这门课的导语叫"通过数学运算,使得信号中潜在的信息变得显然,称为信号处理"

【回复】回复 @小谢爱爬山 : 类比编码,假设我有8类数据作分类,最理想的情况是000-111的二进制即可表示8种情况,但假设我现在记录11111111为第一种情况,88888888为第八种情况,这是一种等价的记法,但显然我这种记录方式更为低效

特征就是这样,我们输入的猫狗图片本身是包含了图像分类的全部信息的,即唯一的图片一定能唯一得出,这张图是猫猫,我们通过运算只不过是让这种信息变得显然,所以扔掉其余信息,保留分类依据这件事叫特征提取,网络中的每一个张量都可以称为特征,他们保留了分类的某种依据

推广一下,所有包含了网络决策信息数据都叫特征,只不过他们的"信息浓度"不一样 盾牌冲唧唧:

盾牌冲唧唧:

我是文科的博士 我一直在想把DL融入自己的研究里面(写作类的课题) 目的是通过深度学习去做更加深层次的数据分析 虽然有一定的代码基础 也上了一些深度学习的课程 但是一直都没有找到一个很合适的学习路径 看什么书会比较合适

【回复】那本书是带你手把手制作深度学习框架(类似pytorch,keras)这种,带你理解这些深度学习框架是如何运作的。唯一缺点就是只写到了VGG16和LSTM,没讲到transformer。不过学完你会感觉深度学习说白了就是用反向传播来做函数逼近,只是每个模型的实现形式和反向传播的机制不同。要求的数学也就是考研数学的水平,理论不难。难的我感觉还是给模型调参。

【回复】深度学习重在数据,模型随便拉一个简单的就能跑

【回复】同样,我是音乐生,在研究音乐方面的信息提取和生成,我个人有一定的经济学底子,所以数学学到过多元微积分,偏微分方程,然后基础统计线代这样子,完全是实用派的数学。我觉得能理解矩阵(矢量)运算,理解导数求最优解,然后可能统计学就是贝叶斯这块,然后自学理解一些信息理论名词比如说熵啥的就至少可以理解模型了,证明比如说非线性啥的完全是不敢妄想[笑哭]。然后之前自学了一下c++,在dl领域基本没用[笑哭]之后搞了本packet的教你python做ml的这种书,然后还有花书,然后oreilly的ai部署这种书,感觉很有用,也是看别人推荐的。我是刚起步,感觉就模型这块难点在设置参数这块,搞几层搞几个node完全靠试,然后就是看其他同领域的paper参考别人的参数,就挺随机的感觉[笑哭] 惊艳萧何:

惊艳萧何:

笑死我了,我的本科论文 基于深层卷积网络的小麦品种鉴别方法设计与实现

【回复】两天跑完代码,然后论文写一个月

【回复】回复 @跳起来学习啦 : 用不了半小时,github搜一下就结束了 Dubai终于有硬币改名了:

Dubai终于有硬币改名了:

bilibiliAI视频总结:

对于卷积神经网络,硕士博士需要理解其原理的程度。作者提到了对于一些基本概念和代码实现要能够理解,并且分享了四个阶段,以帮助学生了解在不同阶段需要达到的理解程度。作者还提到了自己整理的463篇神经网络核心论文的PDF与实现代码,供学习者参考。视频内容详细,对于学习者深入理解卷积神经网络很有帮助。

卷积神经网络的原理和应用,并分享了作者整理的463篇神经网络核心论文的PDF与实现代码。

0:01 卷积神经网络原理的重要性

0:31 Python代码中的关键概念

1:00 463篇神经网络核心论文的整理 李七夜未央:

李七夜未央:

本科计算机调剂到地质了,导师大概说了个剖面,岩心人工智能识别那种的方向,但是之前没怎么接触过应该从哪里自学?大概学习路线是什么

【回复】回复 @刘许森xuson :只能祈祷老师放我出去[笑哭]

【回复】回复 @李七夜未央 :读的时候有空就多找点实习吧只能[笑哭]

【回复】回复 @刘许森xuson :调剂的时候啥都愿意去,现在越来越不想去[笑哭],心累 虾头的鼠鼠:

虾头的鼠鼠:

本科生,会抄代码完成需求,我就很满足了,毕竟我是学光信息的,做做图像处理的小课题[呲牙] 绝不原创的飞龙:

绝不原创的飞龙:

可解释性是一个单独的方向,你感兴趣可以做,但是没必要所有人都去研究可解释性,那样AI就原地打转了。